安装

这个过程其实很简单,看github官方的文档吧。出现的问题大多数为网络问题。

GitHub - AUTOMATIC1111/stable-diffusion-webui: Stable Diffusion web UI

炼丹

想炼出一枚好丹,需要有三个要素,一鼎好用的炉子,炉温控制器和原材料。

对应到Stable Diffusion的过程,炉子代表你使用的Stable Diffusion model;控制器是用来finetune的模型(比如LORA模型);而原材料就是你输入的Prompt,无论文字还是图片,都是影响你最终生成效果的重要指标。

SD Model Checkpoint

要炼丹,先找个好炉子,sd1.4版本的model生成效果属实不怎么样,生成出来的人细节层次太差,都是像下面这种效果。

最抽象的是这个,这是个啥?

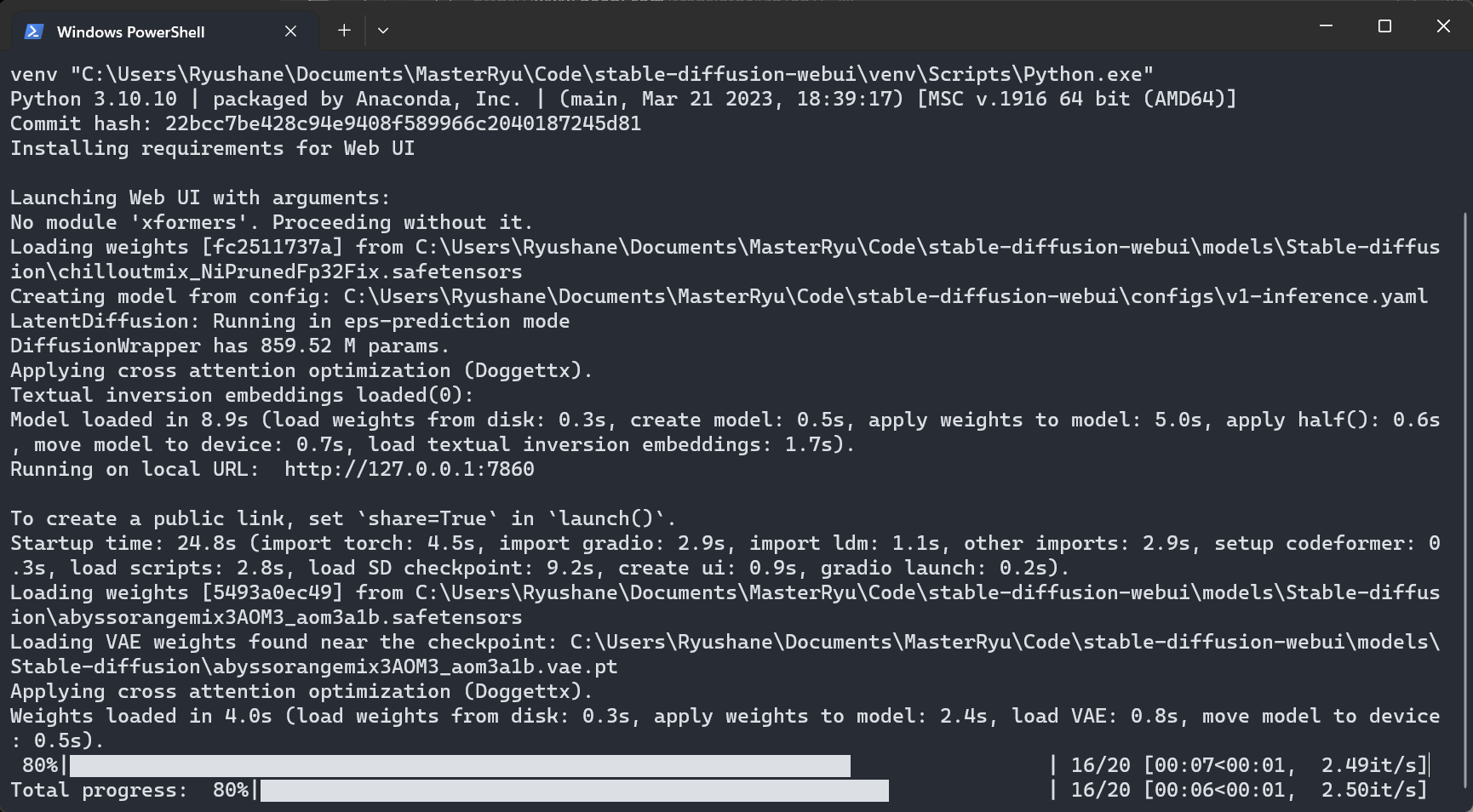

由于sd-webui 1.5的model现在还有输入尺寸不对的bug,所以针对二次元和三次元图片,我找了两个效果比较好的模型,分别是:

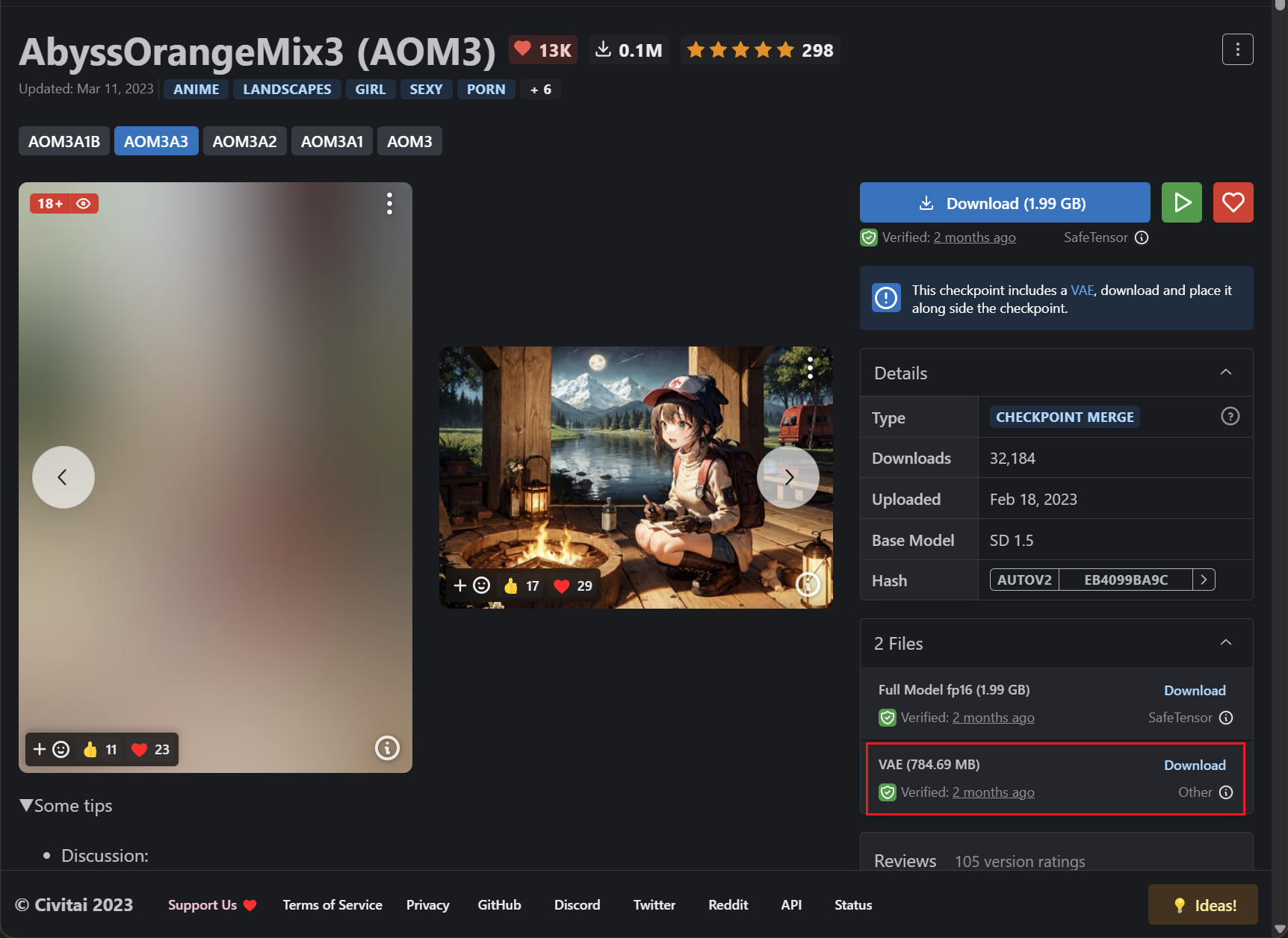

AbyssOrangeMix3 (AOM3) | Stable Diffusion Checkpoint | Civitai

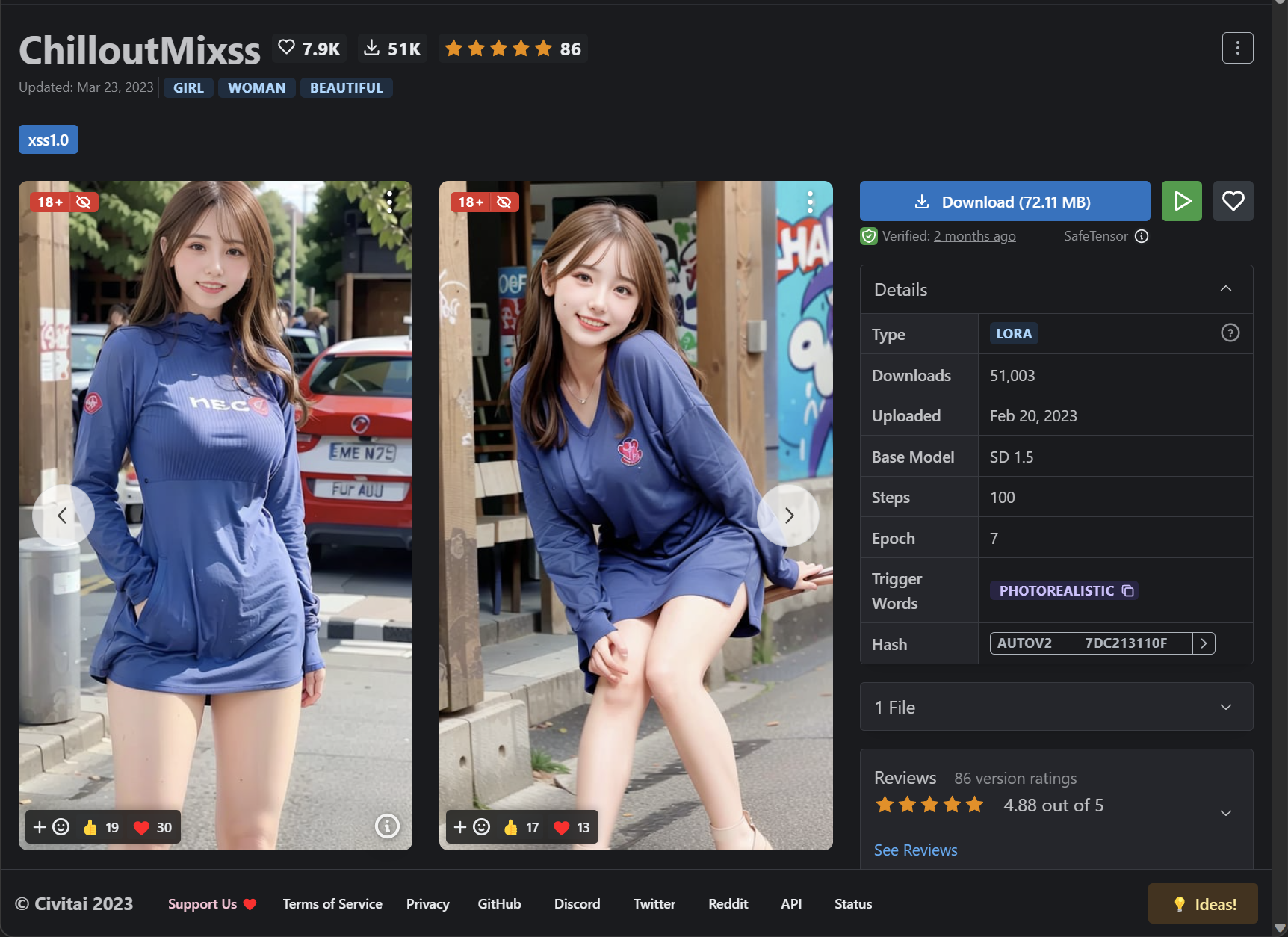

ChilloutMixss | Stable Diffusion LORA | Civitai

需要注意的是AOM3需要将红框所示的VAE文件放到.\stable-diffusion-webui\models\Stable-diffusion目录下,并将vae名字改为abyssorangemix3AOM3_aom3a1b.vae.pt(与你的模型名一致),否则生成的图片会有发灰的问题。

用基于sd1.5的AOM3生成点图片,效果提升的不是一点半点。

但其实可以看到手的效果仍然不咋地,毕竟手的骨骼比较复杂,现在的解决方法有用open pose插件去调整,但是还是比较麻烦,期待后续sd版本能够针对手进行修复。

LORA模型

Civitai | Stable Diffusion models, embeddings, hypernetworks and more

在Civitai上有很多LoRA供你选择,LORA模型是用来对你的基础模型进行Finetune用的。

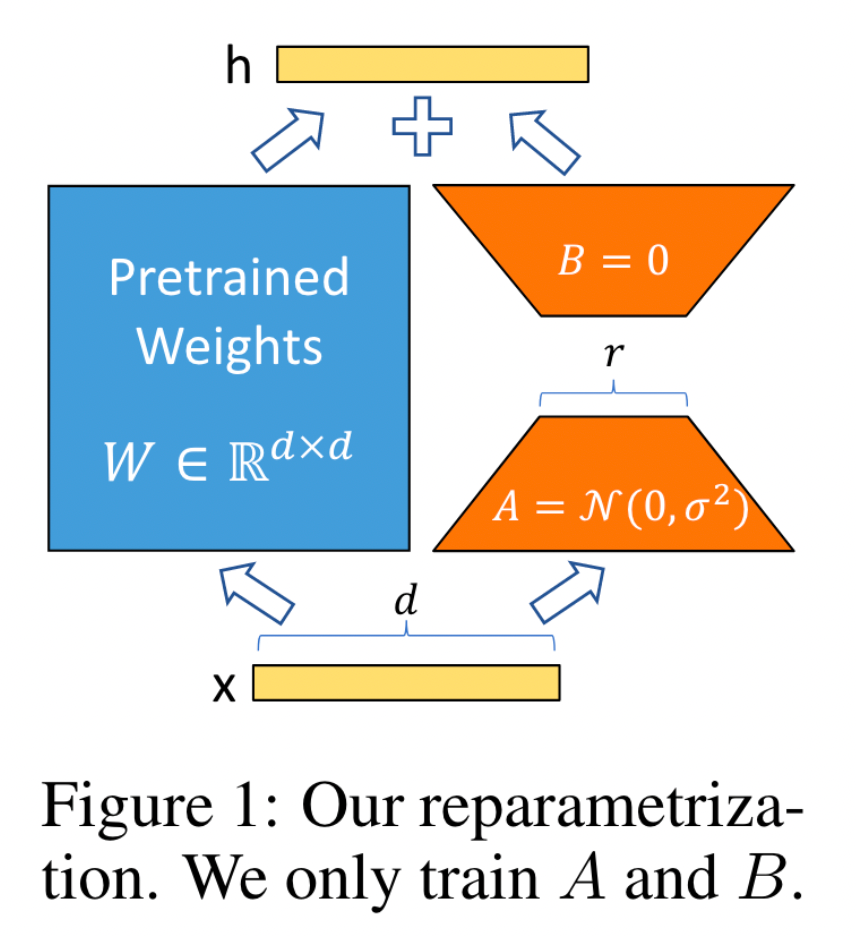

LoRA的基本原理是冻结预训练好的模型权重参数,在冻结原模型参数的情况下,通过往模型中加入额外的网络层,并只训练这些新增的网络层参数。由于这些新增参数数量较少,这样不仅 finetune 的成本显著下降,还能获得和全模型微调类似的效果。

Prompt

Prompt就是你输入的提示,想要生成什么样的角色、场景等描述,其实pixiv或者本子网站给作品打的tag就跟你要输入的Prompt很相似。

进入实践

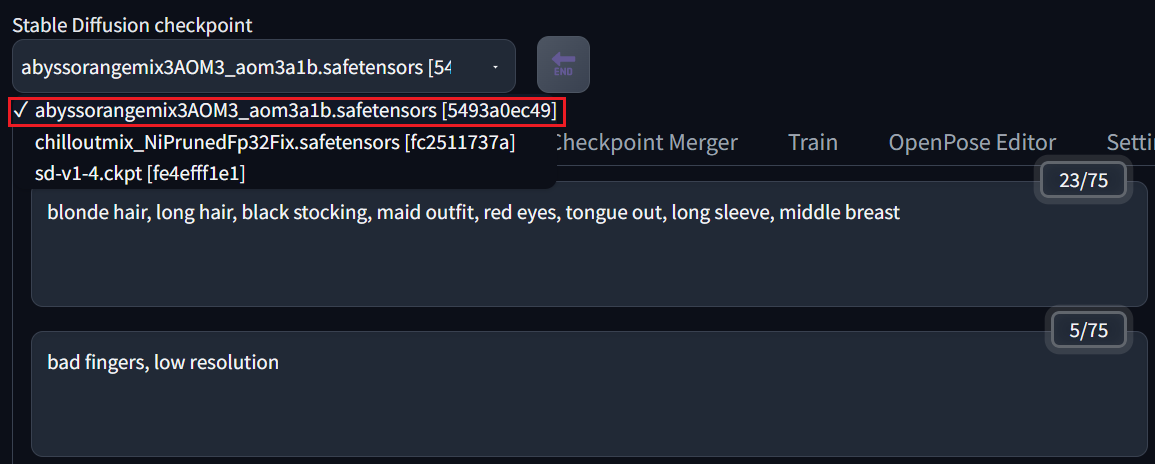

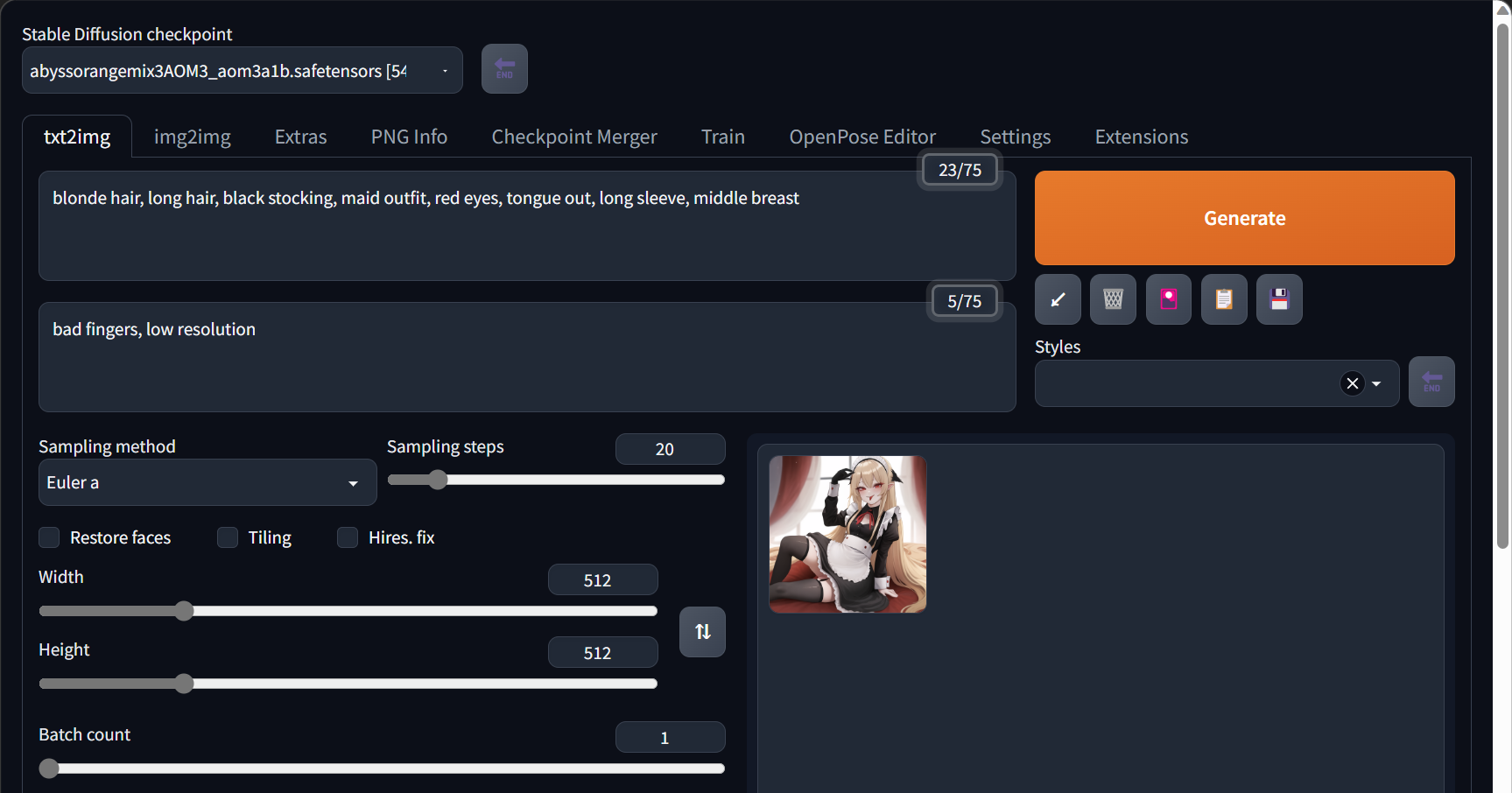

简简单单想个设定,选定Stable Diffusion checkpoint,填好Prompt之后点Generate,注意显卡最低显存要求是4G。

用1080ti基本上十秒钟能出一张512x512的图。

看起来还凑合,像那么回事,但是细看手的细节还是很差,目前SD1.5的模型对于手指的生成效果仍然一般。

又批量生成了几张,手依旧很抽象,而且tongue out这个prompt的作用也太大了,

修改权重,调整一下要素,再试试结果。

调整之后还是有一些看起来更顺眼一点的结果的。

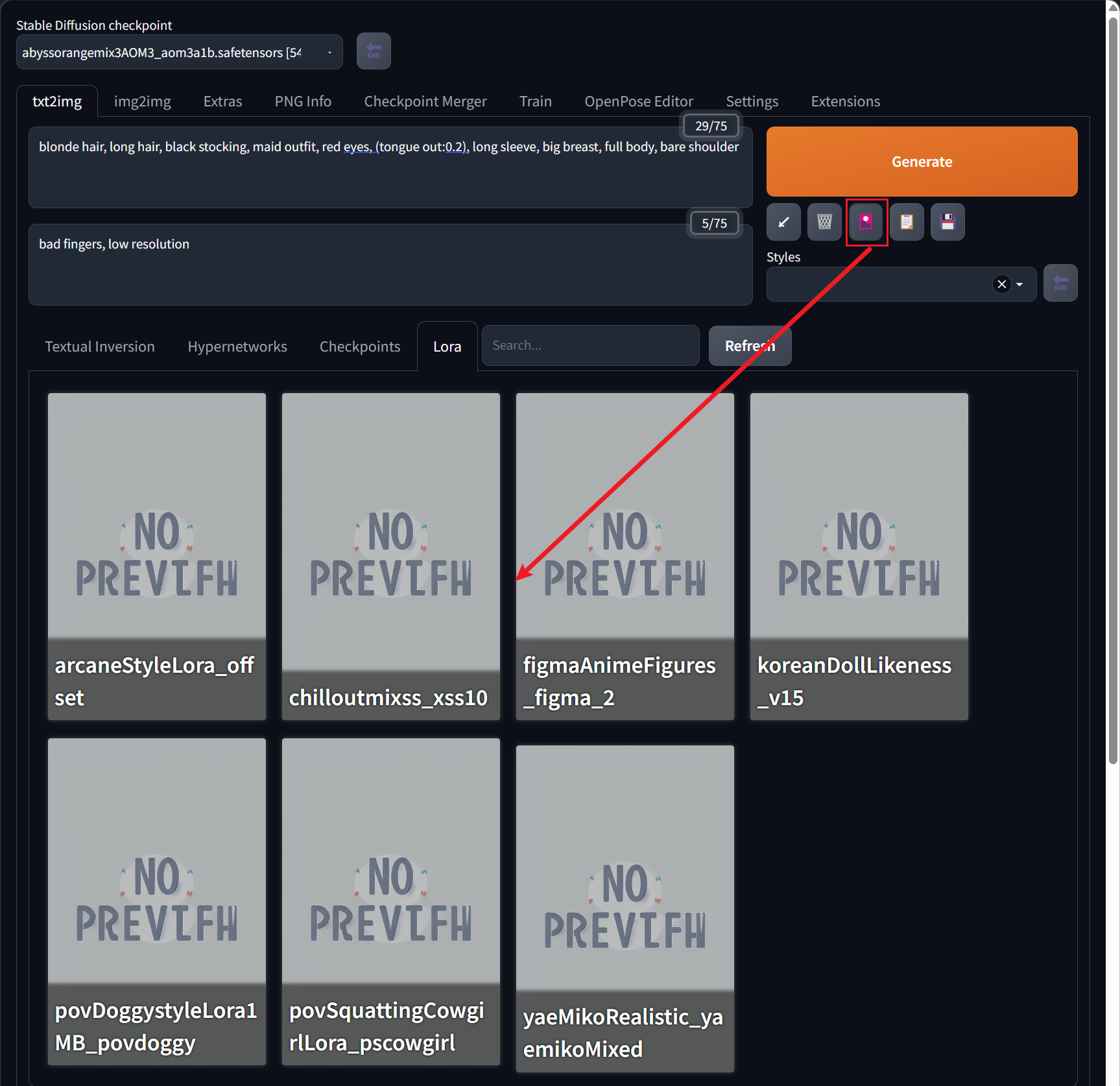

加入LORA model

再webui界面点击generate按钮下面的第三个图标,Show/hide extra networks,然后选择Lora,点击你想要添加的Lora,它会将你所选的lora加到prompt中,然后点击生成。

这里比如我加一个原八重神子的LORA,生成出来的结果是:

有点太逊了,可能是之前输入的prompt跟LORA model差别太大,重新写了个Prompt,并且将纵向分辨率提高到了1024,生成结果如下:

好,到这里你已经初步明白如何使用Stable Diffusion去生成你想要的角色的图片了,下一章,我们来讲img2img的生成方法。